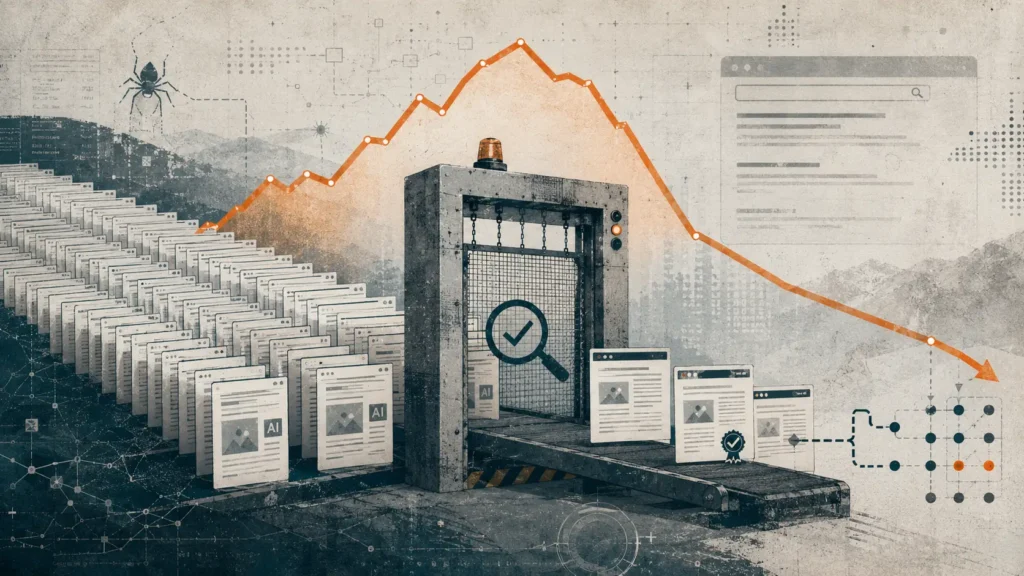

Массовое производство страниц с помощью AI всё чаще даёт один и тот же сценарий: сначала сайт получает всплеск видимости, а затем трафик выходит на плато или начинает снижаться. В материале Search Engine Journal автор Dan Taylor объясняет это не самим фактом использования AI, а тем, что масштабирование контента вскрывает слабые места стратегии, редакционного контроля и технической поддержки сайта.

Ключевая идея статьи — Google может временно активнее обрабатывать новые URL за счёт эффекта новизны, который автор называет “freshness boost”. Но после того как этот эффект проходит, страницы должны соответствовать более устойчивому порогу качества — Google’s Quality Threshold.

Что происходит с масштабированным AI-контентом

По словам автора, проблема возникает не потому, что текст создан AI. Массовая публикация новых URL сама по себе создаёт нагрузку на контентную систему: нужно правильно выбирать темы, выстраивать keyword strategy, редактировать материалы, добавлять внутреннюю перелинковку и продумывать дистрибуцию.

AI в этой модели не столько ломает SEO, сколько ускоряет выпуск слабых страниц. Если сайт публикует большой массив однотипного контента без контроля качества, Google сначала может протестировать часть новых URL, а затем решить, стоит ли дальше тратить ресурсы на их обход, индексацию и показ в поиске.

Этот процесс автор связывает с crawl budget: когда на сайте резко появляется много новых страниц, Google должен перераспределить ресурсы и определить, насколько новый массив URL заслуживает дальнейшего внимания.

Что такое “Mt. AI”

В статье описан типичный график, который часто показывают в SEO-кейсах: после запуска большого количества AI-страниц виден быстрый рост, но затем начинается остановка или спад. Автор называет такой сценарий “Mt. AI”.

В мае 2026 года SEO-специалист Martin Sean Fennon показал в LinkedIn пример брендового кейса, где контент масштабировался через AI, а результат оценивался по сторонним сервисам измерения трафика. Конкретные цифры роста или падения в очищенном тексте не приведены, но кейс используется как иллюстрация более широкой проблемы.

Автор также приводит пример запуска нового бренда в январе 2021 года, где начальный рост тоже сошёл на нет через несколько месяцев. Важно, что этот пример не был связан с AI-контентом: временный буст новых страниц существовал и раньше.

Почему Google может сокращать видимость таких страниц

По версии автора, Google не обязан сразу оценивать весь массив новых URL. Поисковая система может сначала посмотреть на репрезентативную выборку страниц — например, внутри конкретной подпапки или по определённому URL-паттерну.

Если эта выборка показывает слабое качество, низкую релевантность или недостаточную ценность для пользователей, остальные страницы из того же массива могут хуже индексироваться и реже попадать в выдачу. В результате сайт теряет не только стартовый прирост, но и часть ресурсов, которые Google готов выделять на обход и переоценку контента.

Отдельно подчёркивается, что порог качества не является постоянным. Он меняется по мере появления более сильного контента в нише и зависит от тематики: не все поисковые запросы требуют свежих материалов.

Главный вывод для сайтов

Search Engine Journal делает акцент на том, что ставка только на объём становится слабой SEO-стратегией. Масштаб производства должен уступить место масштабной поддержке качества: редактуре, human-led strategy, QA-процессам, внутренней перелинковке и продуманной дистрибуции.

В статье также упоминается формулировка Google из Торонто — “non-commodity content”. Речь идёт о контенте, который не выглядит шаблонным, взаимозаменяемым и созданным только ради заполнения поисковой выдачи.

Для брендов это означает, что AI-контент сам по себе не является гарантией ни роста, ни санкций. Но если AI используется только для быстрого увеличения количества страниц без сильной редакционной системы, сайт рискует получать краткосрочные всплески вместо устойчивой органической видимости.

Источник: Search Engine Journal