Search Engine Journal опубликовал спонсорский материал JetOctopus о том, как меняется технический SEO-аудит в эпоху AI Search. Главная мысль материала: сайтам уже недостаточно быть видимыми только в Google — контент должен быть доступен для ChatGPT, Perplexity, Claude, Gemini и других AI-агентов.

По данным JetOctopus, с середины 2025 года серверные логи сотен enterprise-сайтов показывают устойчивый рост машинного поискового поведения. В компании утверждают, что в 2026 году значительная часть поисковых показов создаётся не прямыми действиями людей, а AI-агентами, которые исследуют сайты от имени пользователей.

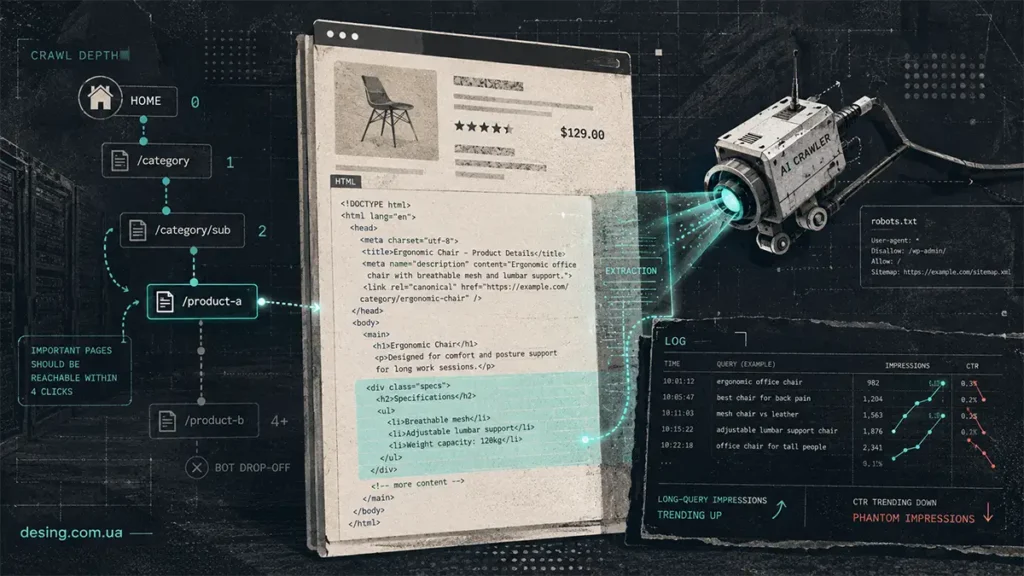

Самый заметный сигнал — рост длинных запросов. JetOctopus сообщает, что 10-словные запросы выросли на 161% год к году, а запросы длиной 7 и более слов к октябрю 2025 года достигли почти 1% общего объёма запросов. Это примерно втрое выше исторической доли.

При этом кликов стало меньше. CTR по 10-словным запросам, по данным компании, упал до 2,26%, тогда как в 2023 году он находился на уровне 8–11%. JetOctopus называет такие показы “phantom impressions”: AI-система читает страницу, извлекает ответ и использует его в выдаче или диалоге, но пользователь не переходит на сайт.

В материале выделены три типа AI-ботов. Training bots обходят сайты для обучения моделей. AI search bots собирают данные для AI-поиска, но быстро теряют активность на глубине. AI user bots запускаются тогда, когда реальный пользователь задаёт вопрос в ChatGPT, Perplexity или Claude. Именно последний тип JetOctopus считает наиболее важным для реальной AI-видимости.

Отдельный акцент сделан на глубине страниц. По наблюдениям JetOctopus, AI search bots резко снижают активность после 2–3 кликов от главной страницы. Поэтому важные глубокие URL, особенно товарные и справочные страницы, рекомендуется выводить в доступность максимум за 4 клика. Это напрямую связано с архитектурой сайта и внутренней перелинковкой.

Robots.txt в статье назван главным техническим рычагом управления AI-ботами. Автор утверждает, что ChatGPT, Claude и Gemini в основном следуют директивам robots.txt. Для Perplexity указано исключение: PerplexityBot соблюдает правила, а Perplexity-User, по данным материала, может их игнорировать.

XML-карты сайта также остаются важными: ChatGPT, Claude и PerplexityBot, по версии JetOctopus, используют sitemap для обнаружения URL. А вот canonical и noindex, как утверждается в материале, не работают как полноценные сигналы для AI-ботов, потому что те не строят классический поисковый индекс.

JetOctopus отдельно критикует LLM.txt: по логам компании крупные AI-боты этот файл не читают. Это важный нюанс для рынка, где всё чаще обсуждают LLMs.txt и его роль в SEO, хотя универсального отраслевого стандарта пока нет.

Ещё одна проблема — JavaScript. В статье говорится, что ChatGPT, Claude и Perplexity не рендерят JavaScript, поэтому страницы, где ключевой контент подгружается на стороне клиента, могут выглядеть для AI-ботов как пустая оболочка. Исключением назван Google Gemini, использующий Web Rendering Service Googlebot.

Для поиска fan-out-запросов JetOctopus предлагает анализировать данные Google Search Console через API. Рекомендуемый фильтр: длина запроса больше 7 слов, impressions меньше 50, clicks = 0, период — последние 3 месяца. По утверждению компании, 95% запросов, которые приводят к AI citations, имеют нулевой monthly search volume.

Отдельный пример — запросы с intent “product review”. По данным JetOctopus, их число выросло с 239 в июне 2025 года до более чем 40 000 в сентябре 2025 года. Это подаётся как рост на 16 000% и как сигнал, что AI-агенты активно собирают структурированные мнения, сравнения, плюсы, минусы и характеристики товаров.

Практический вывод статьи: новый KPI для SEO — technical accessibility. Вопрос уже не только в позициях, ссылках и качестве текста, а в том, может ли AI-агент быстро найти страницу, получить чистый HTML, увидеть ключевой факт и извлечь его за доли секунды. Поэтому стартовой точкой становится SEO-аудит сайта с анализом серверных логов, глубины клика, robots.txt, sitemap и JavaScript-зависимого контента.

Важно учитывать, что материал спонсорский, а данные принадлежат JetOctopus. Методология не раскрыта полностью: неизвестны точное число сайтов, отрасли, регионы, объём логов и способы фильтрации аномалий. Поэтому выводы стоит воспринимать как сильный рыночный сигнал, но не как независимый отраслевой стандарт.

Источник: Search Engine Journal